Il piano era di proiettarlo nelle sale americane per tutto il mese di luglio, ma ovviamente qualcuno ne ha fatto un video con lo smartphone.

A far funzionare le AI ci sono lavoratori sottopagati

Quando ci preoccupiamo che l’AI ci ruberà il lavoro (a proposito: qui la Bbc prova a immaginare quali potrebbero essere le uniche tre professioni che non saranno mai minacciate dall’intelligenza artificiale) dimentichiamo che per farla funzionare è indispensabile il contributo di un essere umano. Un nuovo report di Nbc mostra come OpenAI, la startup dietro all’ormai famoso ChatGPG, paga dei collaboratori esterni statunitensi per svolgere l’inserimento e la classificazione dei dati, ovvero per impartire al software di ChatGPT il “corso di formazione” che gli permette di rispondere alle richieste degli utenti. In pratica, per insegnare a ChatGPT come rubarci il lavoro. Oltre al danno, la beffa: secondo quanto riportato da Nbc, lo svolgimento di questo compito tanto masochista quanto indispensabile è pure sottopagato: soltanto 15 dollari all’ora, senza alcun tipo di benefit.

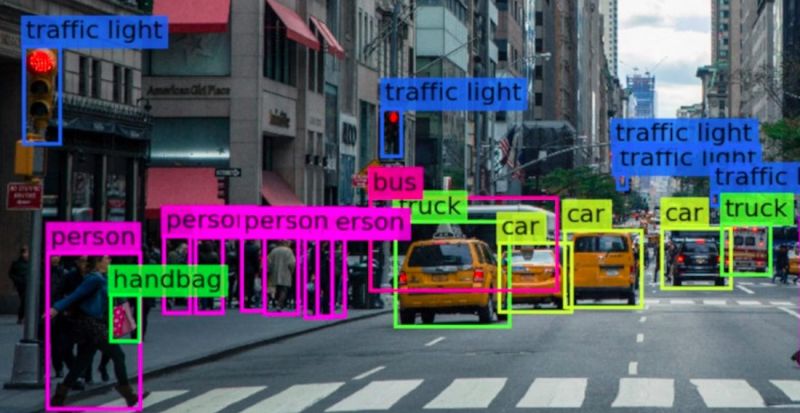

Il data-labeling è il processo di identificazione dei dati grezzi, ovvero il processo che attribuisce un significato a diversi tipi di dati per addestrare un modello di apprendimento automatico a identificare elementi particolari all’interno del set di dati. Gli “etichettatori” contrassegnano gli elementi (immagini visive o tipi di testo) in modo che le macchine possano imparare a identificarli meglio da sole. In questo modo, i lavoratori umani aiutano i sistemi automatizzati a rispondere in modo più accurato alle richieste degli utenti, svolgendo un ruolo importante nella formazione dei modelli di machine learning. Ma, nonostante l’importanza di questa posizione, la maggior parte di questi lavoratori riceve una paga alquanto modesta, poco più del salario minimo di alcuni Stati.

Non è possibile quantificare quanti sono i lavoratori che svolgono questo compito, ma è una forma di lavoro sempre più comune in tutto il mondo. Qualche mese fa la situazione era ancora peggiore: a gennaio Time aveva riportato che OpenAI faceva affidamento su lavoratori kenioti pagandoli meno di 2 dollari per “etichettare” testi che includevano incitamento all’odio o linguaggio sessualmente offensivo in modo che l’app potesse imparare a riconoscere i contenuti tossici.