La chiusura dell'app di generazione di video tramite AI è una notizia improvvisa ma non così imprevista: i problemi legali erano molti e grossi, tutti relativi al diritto d'autore.

Google ha aperto le prenotazioni per una chiacchierata con la sua intelligenza artificiale

Nello scorso giugno l’ingegnere Google Blake Lemoine aveva pubblicato su Medium degli stralci delle conversazioni che aveva avuto con un’intelligenza artificiale di Big G chiamata LaMDA. Il lavoro di Lemoine consisteva – l’imperfetto è d’obbligo, visto che nel frattempo è stato prima sospeso e poi licenziato – nell’assicurarsi che tutto funzionasse a dovere, vale a dire che LaMDA fosse capace di capire gli “stimoli” che gli venivano sottoposti durante la conversazione e di elaborare le corrette risposte. A un certo punto, però, Lemoine ha cominciato a convincersi che LaMDA fosse diventato senziente: secondo lui, l’intelligenza artificiale sarebbe come un bambino di otto anni e dovrebbe essere considerato da Google come un vero e proprio impiegato dell’azienda. Lemoine aveva anche cercato di assumere un avvocato per difendere i diritti di LaMDA in tribunale.

Google ha sempre negato che la sua IA avesse raggiunto la senzienza e ha spiegato l’accaduto con la spiccata fantasia di Lemoine, noto nell’ambiente per la sua ossessione quasi religiosa nei confronti delle intelligenze artificiali. Adesso, come riporta Gizmodo, per fugare tutti i dubbi di quelli che da settimane vivono nel terrore che LaMDA diventerà Skynet, Google ha deciso di dare al pubblico la possibilità di prenotarsi per fare due chiacchiere con l’intelligenza artificiale. Per sicurezza, però, Google ha anche deciso di porre alcuni limiti alla conversazione: non si potrà parlare di qualsiasi cosa in qualsiasi modo, ma le interazioni tra gli utenti e il bot saranno limitate a una serie di scenari decisi in precedenza. Per esempio: in uno degli scenari disponibili si potrà parlare soltanto di cani. A che serve uno scenario del genere, si dirà. Stando a quanto dice Google, è utile per misurare la capacità di LaMDA di “concentrarsi” su un solo argomento, senza divagare.

Prima di consentire agli utenti un più o meno libero accesso a LaMDA, Google si è assicurata che il suo bot non cominciasse a rispondere all’interlocutore con insulti razzisti, sessisti e omofobi. Negli ultimi mesi il team di ingegneri a lavoro sul LaMDA si è concentrato proprio sul trovare, segnalare ed eliminare le risposte offensive che l’intelligenza artificiale talvolta inseriva nella conversazione (LaMDA sa quello che trova su internet, e quindi si può immaginare che la sua area di maggiore competenza sia l’insulto) e imporle una specie di filtro che escluda alcune parole da quelle il cui uso è consentito nelle sue risposte. Nonostante tutte le precauzioni, però, Google sembra consapevole che qualcosa può sempre andare storto: a tutti gli utenti che vorranno provare a parlare con LaMDA, Big G ricorda di «procedere con cautela».

La chiusura dell'app di generazione di video tramite AI è una notizia improvvisa ma non così imprevista: i problemi legali erano molti e grossi, tutti relativi al diritto d'autore.

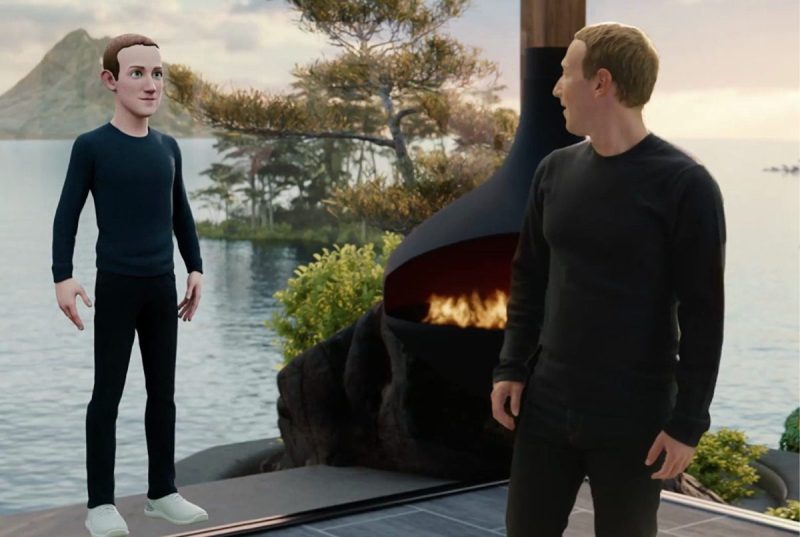

In molti hanno sottolineato una differenza sostanziale tra Zuckerberg e i dipendenti di Meta, però: lui non può essere licenziato e rimpiazzato dall'AI.

La foto del Ministro degli Esteri che esercita il diritto di voto è diventata, suo malgrado, il simbolo di tutto ciò che è andato storto nella campagna per il Sì, tra citazioni sbagliate e foto imbarazzate.

L'uomo si chiama George Georgiou, ha 69 anni e di mestiere fa l'operaio. Ha definito quello che gli è successo «assurdo».

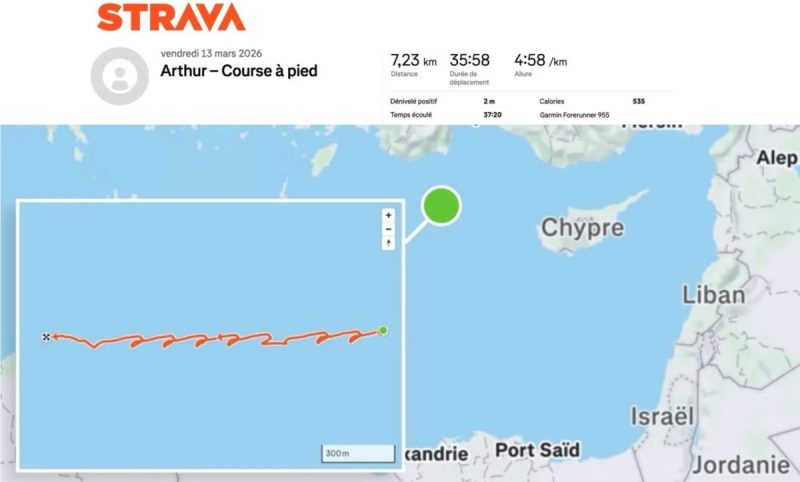

Non è il primo militare a rivelare informazioni sensibili registrando i propri allenamenti, tanto che è stato coniato un nome per il fenomeno degli Strava Leaks.