Nuova serie di cui non si sa assolutamente niente, ma questo non ha impedito alla macchina dell'hype di entrare in funzione.

Cogli la metafora, Google

Come si spiega una metafora a un computer? I colossi dell'informatica vogliono capirlo per creare dispositivi sempre più personali e intimi. Finora però quello di Google Photo non è stato un buon inizio.

Cosa ne sa un computer dei sentimenti, delle nuance di noi imperfetti umani? Ne sa un bel po’, in termini di dati grezzi: aziende come Google e Facebook raccolgono ogni giorno un’enorme mole di informazioni sui nostri gusti, abitudini e vizi, ma hanno il problema dell’estrapolazione e dell’interpretazione, tutte cose in cui eccellono – più o meno – gli umani. O forse è quello che ci piace pensare.

Come dimostrato in settimana da Apple nel suo annuale meeting dedicato agli sviluppatori, le grandi potenze del web vogliono passare alla fase 2 della nostra vita digitale, creando assistenti personali degni di questo nome e applicazioni flessibili con cui gli utenti possono sviluppare un rapporto intimo. Così la nuova funzione “ricerca” anticipa l’utente suggerendo le app più adatte a un dato momento della giornata; Siri – e Google Now e Cortana nell’ambiente Microsoft – puntano in alto, superando il Che tempo farà domani? d’oggi per ambire a un un futuro in cui a domande personali seguiranno risposte personalizzate. Per riuscirci, le aziende devono risolvere l’enigma umano: cosa intendiamo quando diciamo una certa parola in un determinato contesto? Cosa rappresenta una foto e, soprattutto, cosa rappresenta quella foto per l’utente X?

Per capirci qualcosa, bisogna affrontare l’incubo di qualsiasi pezzo di ferraglia: l’ambiguità. Nel mondo umano ogni parola ha significati diversi a seconda dei contesti o della percezione individuale – anche magari sbagliata – ma da tenere in conto se si vuole davvero programmare un servitore fedele. È per questo che le metafore diventano importanti. Secondo Wikipedia una metafora è una figura retorica che «si ha quando, al termine che normalmente occuperebbe il posto nella frase, se ne sostituisce un altro la cui “essenza” o funzione va a sovrapporsi a quella del termine originario creando, così, immagini di forte carica espressiva». Provate a spiegare questa roba usando un linguaggio di programmazione. Un incubo. Ma un incubo inevitabile, proprio perché una volta “crackata” questa parte di ambiguità umana, un computer può dirsi dotato di un’intelligenza più simile a quella umana.

Che è un concetto molto bello, certo, ma a Google & Co. interessa perlopiù perché sarebbe un business inestimabile. Pensateci: uno smartphone in grado di capire, di anticipare, di intrattenere un discorso tanto umano da portarci nell’uncanny valley.

Computer sentimentaloni: è questo il futuro.

Poetry For Robots è un’iniziativa congiunta della Arizona State University, Neologic Labs e Webvisions che vuole capire come insegnare a una macchina il valore delle metafore, ovvero inserire un messaggio in un programma spiegandogli che in realtà vuol dire un’altra cosa. Il passo successivo è più ambizioso: insegnare a queste macchine come capirle. Tempo fa avevamo parlato di un progetto simile in cui un computer componeva poesie ma in questo caso ci stiamo muovendo in senso opposto al precedente: prima di far poetare la macchina, la si sottopone a metafore e messaggi poetici, la si lascia sbagliare e migliorare, fino a simulare la comprensione con un codice. La poesia, in questo caso, è un mezzo per dotare i computer di capacità relazionali migliori e necessarie per la fase due della vita digitale alla quale abbiamo accennato. Computer sentimentaloni: è questo il futuro.

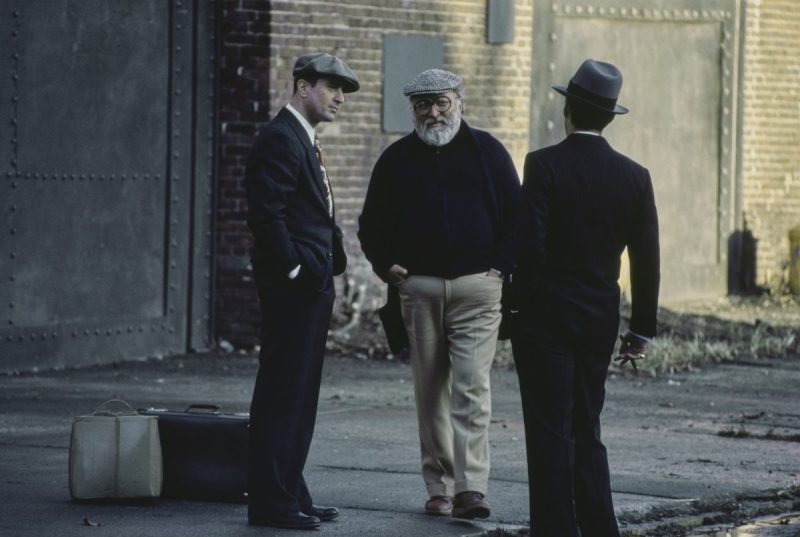

E a proposito di emozioni, un paio di settimane fa Google ha presentato Google Photo, un nuovo servizio che fornisce spazio digitale illimitato per le immagini dei suoi utenti. Una bella novità, ma non è questo a rendere Photo incredibile, è più che altro Assistant. Assistant è la parte “intelligente” del software, un programma che analizza foto e video caricati dall’utente, li guarda, li analizza e poi li gestisce; non solo, è anche piuttosto indipendente, in grado di mettere mano ai documenti cercando una chiave, un pattern, da usare per creare compilation tematiche (tipo: Io al mare) o video accompagnati da una colonna sonora che il programma sceglie in base al mood delle immagini.

Ryan Gantz ha raccontato la sua esperienza su The Verge, quella di un giovane padre amante della fotografia che ovviamente scatta molte foto dei suoi figli. Recentemente l’uomo ha subito la perdita di sua nonna, ed è facile immaginare che il rullino di Gantz sia carico di emozioni forti. Che lo abbia capito anche Google?

Non proprio. Nel caso di Gantz, Google Photo ha sicuramente capito la portata emotiva del set fotografico – bambini che giocano, crescono, fanno cose per la prima volta – quella dell’album familiare da sfogliare con nostalgia nei decenni a venire, da mostrare ai figli quando saranno grandi. Il programma ha quindi realizzato un video (riproposto in questa pagina), azzeccando pure la musica di sottofondo. C’è però un dettaglio: quelle foto scattate al funerale del nonno dell’utente che spuntano di tanto in tanto, come opera di un montatore sadico. Google Photos non ha capito l’abisso emozionale tra i due set di immagini, non ancora in grado di interpretare messaggi ambigui proprio perché umani (cosa c’è più umano di un vecchio che muore mentre un bambino gioca?).

Tutto sommato, Gantz l’ha presa bene: «La morte e la perdita sono parte della vita, e dobbiamo continuare a correre sempre, dritti verso il sole», ha scritto riguardo al video, per poi aggiungere: «L’ho salvato nella mia libreria».