Nuova serie di cui non si sa assolutamente niente, ma questo non ha impedito alla macchina dell'hype di entrare in funzione.

Ma gli androidi sognano diritti civili?

Una proposta in discussione al Parlamento Ue può essere l'antipasto di un futuro in cui i robot pretenderanno di votare e riprodursi.

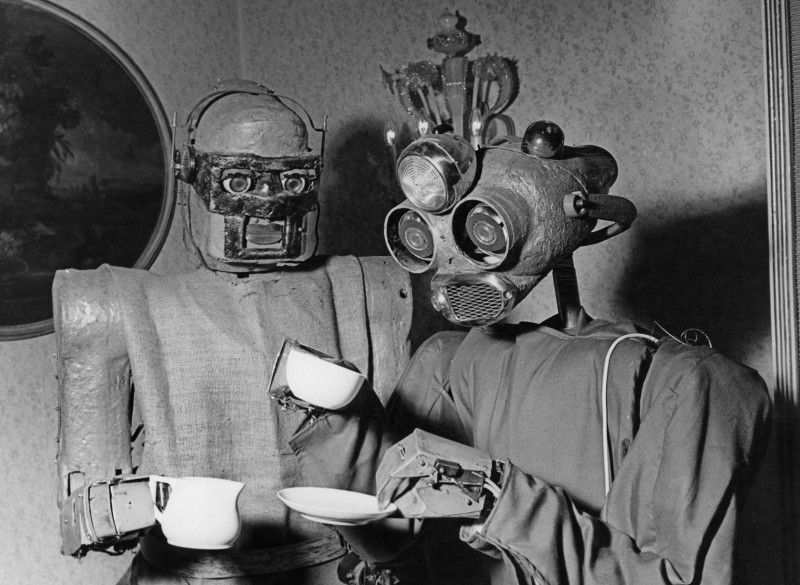

Non chiamateli robot, un termine che nel futuro sarà considerato dispregiativo e al quale sarà preferito il politicamente corretto «persone elettroniche». Questo, almeno, è quanto avverrebbe se andasse in porto una proposta depositata al Parlamento europeo in cui, tra le altre cose, si chiede che «almeno ai robot autonomi più sofisticati venga fornito lo status di persone elettroniche, con specifici diritti e doveri».

La proposta europea non mira tanto alla tutela dei robot, quanto a porre le basi per un futuro in cui le grandi aziende siano obbligate a dichiarare quanto risparmiano grazie all’utilizzo delle «electronic persons» e a sostenere il sistema fiscale e previdenziale, contribuendo a far fronte allo spettro della disoccupazione di massa causata da un esercito di robot pronti a rubarci il lavoro. Un punto direttamente volto a favorire i robot in quanto tali, però, c’è: quello che fa riferimento alla proprietà intellettuale di poesie, canzoni e opere d’arte che, effettivamente, le intelligenze artificiali hanno iniziato a creare.

In ogni caso, nonostante le ragioni che hanno portato alla proposta europea siano soprattutto “umane”, il riconoscimento di questo status alle macchine artificiali sarebbe comunque un passaggio storico, che porta inevitabilmente a una domanda: se i robot sono persone, dobbiamo preoccuparci di garantire loro i diritti civili?

Stando a quanto scrive Luciano Floridi, professore di Etica a Oxford, si tratta di una preoccupazione prematura, perché bisognerebbe almeno attendere che gli androidi sviluppino una forma di autocoscienza, la condizione senza la quale non è possibile parlare di “persona”: «In che modo un’intelligenza artificiale possa evolvere autonomamente partendo dalle abilità necessarie, per esempio, a parcheggiare un’automobile in uno spazio stretto è ancora poco chiaro. La verità è che salire in cima a un albero non è il primo passo per arrivare alla Luna, ma è la fine del viaggio».

Altri studiosi, come quelli che fanno riferimento alla cosiddetta singolarità tecnologica, non sono così scettici sulla possibilità che i robot progrediscano fino a prendere coscienza di se stessi. Il problema semmai è come capire se i robot si stanno evolvendo a un ritmo tale da rendere necessario preoccuparsi dei loro diritti civili (prima, magari, che decidano di ribellarsi riducendo l’umanità in schiavitù).

Generalmente si fa riferimento al test di Turing, un criterio per determinare se una macchina è in grado di mostrare un comportamento abbastanza intelligente da non rendere più possibile distinguerla da un essere umano. Nel mondo della fantascienza più mainstream, il test di Turing (o qualcosa di molto simile) è stato utilizzato in Blade Runner per distinguere gli esseri umani dai replicanti e in Ex Machina per valutare l’evoluzione dell’androide Ava. In quello reale, però, siamo ancora ben lontani da tutto ciò: nonostante in ben tre casi sia stato rivendicato il successo in questo test, nessun computer l’ha ancora passato senza ricorrere a escamotage di vario tipo.

Non solo: Luciano Floridi contesta anche l’assunto secondo cui dobbiamo considerare una macchina intelligente nel momento in cui non riusciamo a distinguerla da un essere umano: il test di Turing in questo senso fornirebbe solo una condizione necessaria, ma non sufficiente. Dal punto di vista cognitivo, insomma, essere in grado di simulare un comportamento intelligente è cosa ben diversa dall’essere intelligente.

La posizione di Floridi viene però contestata da un altro professore di Oxford, il matematico Marcus du Sautoy, che propone di affiancare al Turing una seconda prova: il test del “riconoscimento nello specchio”. «Questa prova ha lo scopo di capire se un bambino (o un robot) è in grado di riconoscere la sua immagine e ha quindi sviluppato il senso del sé. Nel momento in cui ci accorgeremo che queste tecnologie hanno raggiunto un certo livello di coscienza, dovremo fornire loro dei diritti umani».

Eppure farlo non sarebbe una passeggiata: tra i diritti umani ci sono anche il diritto alla vita e quello al benessere (che ci impedirebbero di “uccidere” un robot, cioè di spegnerlo), il diritto alla libertà dalla schiavitù (che farebbe venire meno la ragione stessa per cui li stiamo creando) e il diritto alla procreazione, cioè permettere a un robot di creare copie di se stesso, l’unico modo in cui sarebbe in grado di procreare.

Dai diritti umani (tra i quali è contemplata anche la libertà di espressione: siamo pronti a non limitare il campo degli interventi delle macchine artificiali?) al diritto di voto, il passo è breve. D’altra parte, come si potrebbe negare a dei robot dotati di coscienza e che svolgono un ruolo produttivo nella società la possibilità di esprimersi politicamente? Arrivati a questo punto, la nostra società farebbe cortocircuito: «Le macchine rivendicheranno il diritto di fare copie di se stesse», sostiene in un saggio il professore di Legge all’Università di Washington Ryan Calo. «I robot (e tutte le loro copie) vorranno anche avere una loro rappresentanza in Parlamento e, infine, chiederanno di accedere al suffragio. Ovviamente, conferire questi diritti a esseri capaci di replicarsi in copie infinite distruggerebbe il nostro sistema di governo. Di quale diritto li priveremmo, allora: di quello fondamentale alla procreazione o di quello democratico alla partecipazione?».

Come si potrebbe negare a dei robot dotati di coscienza e che svolgono un ruolo produttivo nella società la possibilità di esprimersi politicamente?

Probabilmente, dovremmo privarli del diritto alla procreazione. Magari scovando qualche cavillo legale, come immaginato dal fisico e filosofo David Deutsch, secondo il quale dovremmo considerare come «una sola persona» tutte le copie di un robot, almeno fino a quando non inizieranno a differenziarsi grazie a diverse esperienze o decisioni. La questione, per quanto ultra-futuribile, è decisiva: in linea teorica sarebbe sufficiente che un’intelligenza artificiale imparasse a replicarsi all’interno di numerose macchine per aumentare esponenzialmente il suo peso elettorale. E magari un giorno diventare Presidente-robot della Repubblica.

Nulla lo esclude, visto che la Costituzione Italiana prevede che possa essere eletto presidente della Repubblica «ogni cittadino che abbia compiuto quaranta anni di età e goda dei diritti civili e politici». Visto che siamo in periodo di riforme costituzionali, forse dovremmo approfittarne per inserire da qualche parte il termine «essere umano». Ma è davvero il caso di interrogarsi su scenari che non solo sono molto lontani da venire, ma anche ancora ipotetici? In verità, sì. Anzi, se si considera ad esempio il vuoto legislativo riguardante le “self-driving car”, siamo già in ritardo. Mancano solo pochi anni alla messa in commercio delle auto che si guidano da sole e ancora non c’è una risposta alla domanda più scontata: di chi è la responsabilità se una di queste auto causa un incidente? Del guidatore, della macchina o del programmatore? Di tutti e tre o di nessuno?

La questione, in questo caso, è molto attuale. Nel febbraio di quest’anno, come racconta lo Scientific American, «una self-driving car di Google ha causato per la prima volta un incidente. Dopo aver individuato un ostacolo, la macchina si è spostata nella corsia centrale per evitare l’impatto. Tre secondi dopo si è scontrata con la fiancata di un bus. Stando al rapporto dell’incidente, l’intelligenza artificiale ai comandi della vettura aveva visto il bus, ma supponeva che avrebbe rallentato per permettere alla macchina di spostarsi nella sua corsia».

Non è la prima volta che una di queste vetture viene coinvolta in un incidente, ma è la prima volta in cui è l’auto senza pilota a causarlo. Da qui, la domanda: di chi è la responsabilità? Secondo gli esperti, lo scenario legislativo più probabile è che la colpa non ricada sul proprietario dell’auto (se non è responsabile dell’accaduto), ma sull’azienda che ha costruito il software che “guida” la vettura. In questo caso, quindi, a pagare i danni causati al bus sarà Google. Si tratta di un precedente importante, perché potrebbe sollevarci da ogni responsabilità per i danni causati dai robot che, nel futuro, manderemo a svolgere le commissioni al posto nostro. E soprattutto perché sapremo a chi dare la colpa nel momento in cui le intelligenze artificiali si ribelleranno agli umani, trasformando il sogno di un futuro tecnologico nell’incubo distopico di Skynet e Terminator.