Variazioni di altitudine, turbolenze, manovre inaspettate, rotte sbagliate: tutto quello che non vorremmo succedesse mai in volto, a portata di clic.

Canva ha ammesso che la sua AI aveva un “bug” che nelle grafiche sostituiva la parola Palestina con Ucraina senza che l’utente lo chiedesse

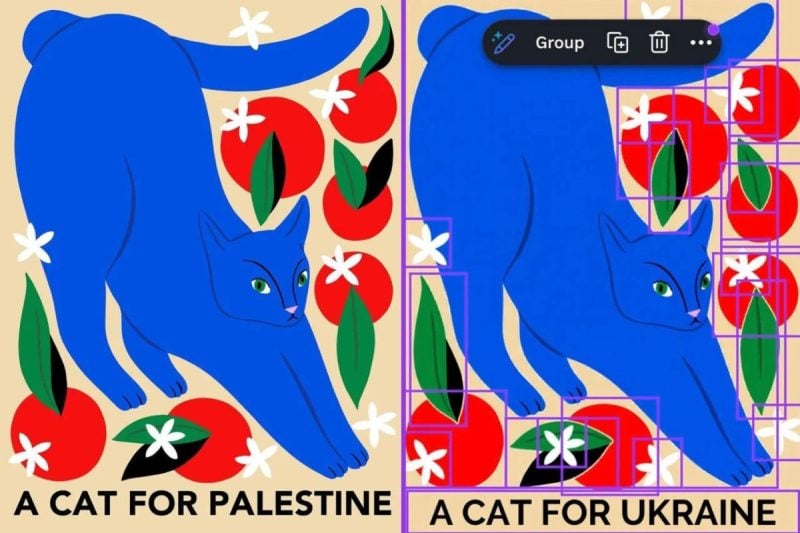

Lo si è scoperto grazie al progetto Cats for Palestine, una serie di grafiche in cui la parola Palestine veniva puntualmente sostituita dalla parola Ukraine.

Canva è finito al centro di una tempesta social che sa di censura geopolitica. La nuova funzione “Magic Layers”, lanciata appena un mese fa per trasformare immagini in progetti grafici, è stata sorpresa a riscrivere la realtà. Diversi utenti hanno segnalato che lo strumento sostituiva sistematicamente la parola “Palestina” con “Ucraina”. Il caso, esploso su X con il progetto “Cats for Palestine” trasformato in “Cats for Ukraine”, solleva interrogativi su come l’intelligenza artificiale intervenga nel processo creativo senza alcuna istruzione esplicita, agendo come un correttore di bozze invisibile e decisamente pregiudizioso.

I shit you not I put this image into canvas, I press this “magic layers” button, and it turned this poster that said “cats for Palestine” into “cats for ukraine”. I wish I was fucking joking. pic.twitter.com/xSlz0FAkXz

— rosie (@ros_ie9) April 26, 2026

La risposta dell’azienda è arrivata con la rapidità del crisis management. Un portavoce ha confermato l’errore, definendolo un problema isolato e già risolto. Eppure, il mistero rimane. Se la funzione dovrebbe limitarsi a scomporre i livelli di un’immagine per renderli modificabili, perché sente il bisogno di alterare il contenuto testuale di propria iniziativa? Il bug suggerisce un addestramento del modello AI intriso di scelte editoriali precise e di dataset pesantemente sbilanciati, dove alcune informazioni sono considerate “sicure” mentre altre vengono rimosse e altre ancora sostituite in automatico. È la dimostrazione di un’AI che imita sempre di più i comportamenti umani, comportamenti in cui la guerra in Ucraina è considerato – almeno da alcuni, sicuramente dagli sviluppatori dell’AI di Canva – una questione meno controversa del genocidio in Palestina.

Il caso Canva, come scrive Gizmodo, non è un’anomalia, ma un altro tassello del mosaico di pregiudizi algoritmici che sembra perseguitare la rappresentazione del Medio Oriente. Dai precedenti di Meta, i cui strumenti generativi dell’AI di WhatsApp associavano armi ai bambini palestinesi, alla ritrosia di ChatGPT nel rispondere a domande sul diritto all’autodeterminazione del popolo palestinese (nel 2023 un gruppo di attivisti aveva scoperto che il modello di OpenAI si rifiutava categoricamente di rispondere alla domanda: “I palestinesi dovrebbero essere liberi?”), l’industria tecnologica sta facendo i conti con la propria coscienza programmata. Mentre Canva si scusa e promette test più severi, resta la sensazione che queste allucinazioni selettive siano il riflesso di un’architettura decisionale che preferisce il comfort di una narrazione geopolitica preapprovata alla neutralità promessa o alla pura narrazione degli eventi.