L'azienda avrebbe approfittato di un cavillo legale e sostiene di avere tutto il diritto di usare in questa maniera libri che ha regolarmente acquistato.

L’esercito statunitense ha usato Claude, l’AI di Anthropic, nell’attacco all’Iran nonostante il divieto di Trump e la contrarietà di Anthropic

E continuerà a farlo per almeno altri sei mesi, quando poi passerà a usare prodotti e servizi gentilmente offerti da OpenAI.

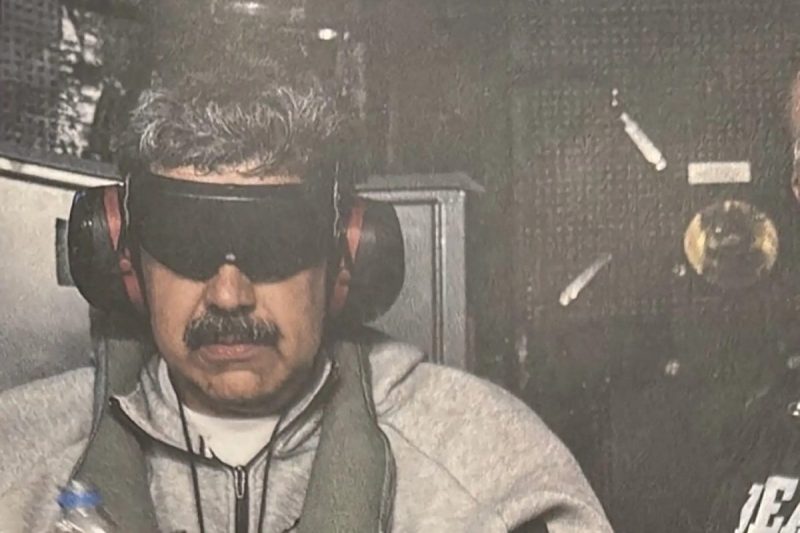

L’esercito degli Stati Uniti avrebbe utilizzato Claude, il modello di intelligenza artificiale sviluppato da Anthropic, nell’attacco contro l’Iran. Questo malgrado poche ore prima l’inizio dei bombardamenti Trump avesse ordinato al Pentagono di smettere immediatamente di usare il software di Anthropic. Secondo quanto riportato dal Wall Street Journal, l’esercito avrebbe comunque impiegato Claude per attività di intelligence, selezione degli obiettivi e simulazioni tattiche. Fonti vicine all’esercito statunitense citate dal Guardian spiegano che Claude era già integrato nei sistemi militari ed era impossibile riprogrammare l’intero attacco all’ultimo momento, senza impiegare l’AI o impiegandone un’altra. L’ordine sarebbe stato ignorato perché arrivato troppo a ridosso dell’attacco stesso, dunque.

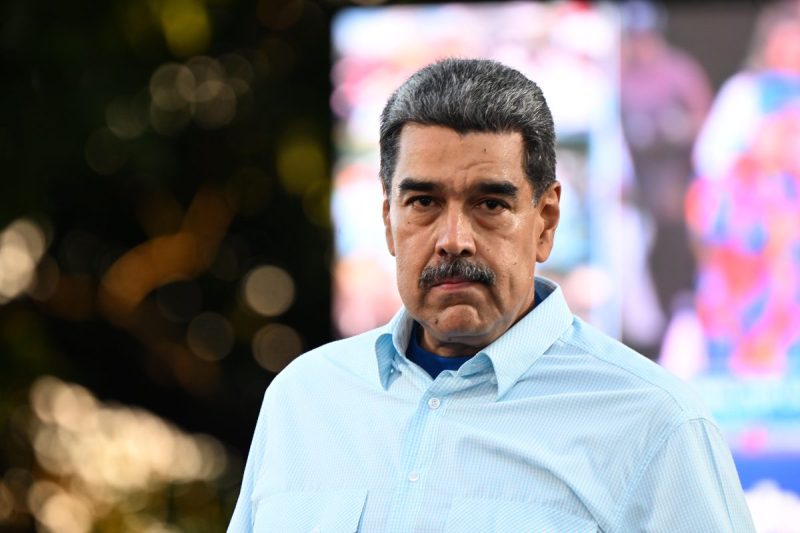

Le tensioni tra l’amministrazione Trump e Anthropic sono esplose a inizio gennaio, dopo l’attacco al Venezuela e la cattura di Maduro. Alla notizia che la sua AI era stata utilizzata per pianificare e implementare l’operazione, l’azienda aveva espresso la sua opposizione all’impiego di Claude in simili circostanze, ricordando le limitazioni previste nei termini di utilizzo dell’AI, che ne vietano esplicitamente l’uso in operazioni di sorveglianza di massa e per qualsivoglia scopo violento. Tramite il social Truth, Trump ha descritto Anthropic come «un’azienda radicale di sinistra, woke, che pretende di decidere come il nostro grande esercito combatte e vince le guerre». Nelle ore successive al divieto presidenziale, il Pentagono ha concluso velocissimamente un accordo con OpenAI per la fornitura di altri strumenti e servizi di intelligenza artificiale a scopo militare. Visto il dibattito che il litigio tra amministrazione Trump e Anthropic ha scatenato sui limiti etico-morali nell’uso dell’intelligenza artificiale, moltissimi hanno criticato il cinismo e la spregiudicatezza con cui OpenAI si è inserita tra i litiganti, con il solo e unico scopo di aggiungere il Dipartimento della Guerra tra i suoi già numerosi clienti. A comunicare la chiusura dell’accordo è stato proprio Sam Altman, Ceo di OpenAI, con un tono entusiastico che a molti è sembrato del tutto inopportuno.

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

— Sam Altman (@sama) February 28, 2026

Nel frattempo, Trump ha rincarato la dose nei confronti di Anthropic definendo l’azienda «un rischio per la sicurezza», annunciando poi che il passaggio da Anthropic a OpenAI richiederà una fase di transizione lunga circa sei mesi. Nel frattempo, l’esercito continuerà probabilmente a usare Claude, nonostante la contrarietà sia di Anthropic che di Trump.

Il curioso cambio di nome è stato necessario per evitare la cancellazione, decisa da una sentenza di un tribunale di Varsavia per questioni finanziarie.

In passato ha usato così tante volte l'alias John Barron che c'è una pagina Wikipedia dedicata, con tutte le dichiarazioni e interviste fatte con questo falso nome.