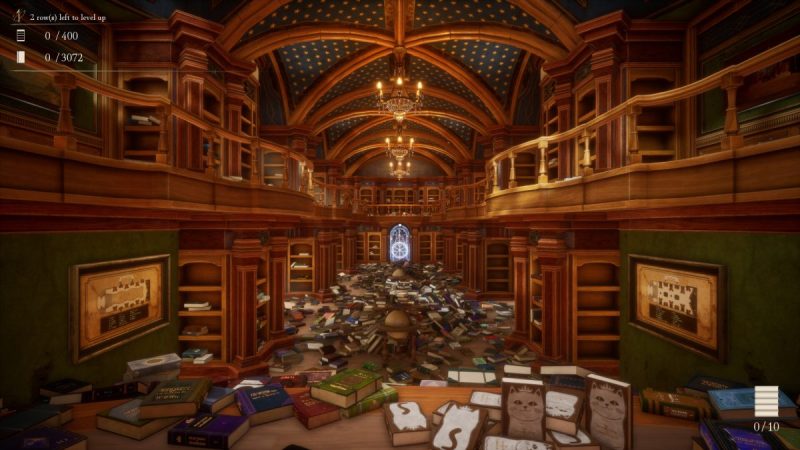

Si intitola Librarian: Tidy Up The Arcane Library, giocarci è molto rilassante, basta avere la consapevolezza che la missione è impossibile.

La guerra della disinformazione

Il conflitto in Medio Oriente ci sta impartendo ancora una volta una lezione che abbiamo già imparato prima con la pandemia e poi con l'invasione russa dell'Ucraina: i social non sono più i luoghi delle notizie.

I social sono una cosa ancora recente abbastanza da permetterci di ricordare com’erano prima che l’enshittification – il neologismo inventato da Cory Doctorow nel 2022 per riassumere il processo di platform decay – cominciasse. A scorrere i contenuti proposti da X in “For you” oggi è difficile non pensare al Twitter dell’1 maggio del 2011, quando un ignaro Sohaib Athar, software designer originario del Punjab trasferitosi in Pakistan assieme alla famiglia, twittava «Helicopter hovering above Abbottabad at 1AM (is a rare event)». Alla sette del mattino seguente, dopo una notte di tweet, Athar capiva che «Uh oh, now I’m the guy who liveblogged the Osama raid without knowing it». Erano gli anni in cui tutti quanti credevamo che Twitter – ma non solo: tutti i social media – fosse una nuova fonte d’informazione. Un media, appunto. Liberato però dai lacci e lacciuoli che impediscono ai media tradizionali di compiere la loro missione, una piattaforma democratica e popolare grazie alla quale il software designer di Abbotabad o il commerciante di piazza Tahrir possono diventare i cronisti più importanti del mondo senza nemmeno rendersene conto.

Avanti veloce dall’1 maggio del 2011 al 7 ottobre del 2023. «Il livello di disinformazione sulla guerra tra Israele e Hamas che Twitter ha algoritmicamente promosso è un qualcosa al quale non ho mai assistito prima nella mia carriera di scienziato politico», ha scritto Ian Bremmer il 9 ottobre. In un’intervista concessa al Reuters Institute, il giornalista di Bbc Monitoring – team che fa parte del più ampio progetto Bbc Verify – Shayan Sardarizadeh ha detto che questo nuovo capitolo del conflitto israelo-palestinese ci ha esposto a «una quantità di disinformazione che non avevo mai visto». Cos’è successo in poco più di dieci anni? “Social media abdicated responsibility for the news”, diceva il titolo di un articolo scritto sul New Yorker da Kayle Chayka il 17 ottobre. Nel mezzo, tra il 2011 e il 2023, ci sono stati enshittification, platform decay, decadimento e putrefazione.

Per Meta è diventato più conveniente escludere dal feed le notizie prodotte dai cosiddetti legacy media, perché questi hanno cominciato a pretendere di essere pagati in cambio di questi contenuti. In Canada hanno approvato un Online News Act per obbligare Meta – e Google e tutti gli altri – a questo equo compenso. Risultato: dal Facebook canadese sono spariti i link che rimandano ai siti d’informazione “tradizionali”, conservati i meme e lo shitposting, il traffico sulla piattaforma è rimasto lo stesso. Musk ha licenziato tutto il personale che si occupava di moderazione dei contenuti, affidandola a debunker per hobby riuniti sotto l’altisonante nome di Community Notes. Sono gli stessi utenti di X – aggratis, si capisce – a segnalare se una notizia è falsa, e come, e quanto, e a decidere come segnalarlo e spiegarlo agli altri utenti. Il fact checking diventa così una passione a tempo perso o un mestiere part time o un vero e proprio vanity project personale, un impiego portato avanti per vanità o diletto o spirito di sacrificio da persone di cui spesso non c’è modo di verificare competenze professionali, esperienze nel settore, interessi ulteriori. Come abbiamo visto nel caso del bombardamento dell’ospedale Al-Ahli di Gaza, fact checking e debunking svolti in questa maniera intorbidiscono ulteriormente acque già nere. In questo fallibilissimo sistema è incappato anche Donald Trump Jr., che ha pubblicato un video in cui si vedevano terroristi di Hamas che uccidevano civili israeliani, se lo è visto definire «vecchio e non registrato in Israele», per poi scoprire che aveva ragione lui, il controllato, e torto loro, i controllori.

E anche quando un contenuto viene segnalato come veicolo di fake news, la cosa comunque non impedisce all’algoritmo di spingerli, questi contenuti, purché siano prodotti dagli utenti detentori di spunta blu previo pagamento. Risultato: il 74 per cento delle bufale sul conflitto in Medio Oriente che si leggono su X vengono da account “verificati”. Telegram rimane una terra di nessuno nella quale le brigate Al-Qassam possono aprirsi un loro canale e accumulare centinaia di migliaia di iscritti. Dell’algoritmo di TikTok l’unica cosa che sappiamo è che non è granché interessato alle notizie. E alla verifica delle notizie. Che fare? Probabilmente non c’è nulla che si possa fare, ormai: è troppo tardi per trattare i social come le altre aziende di telecomunicazione e sottoporli a obblighi di legge che non sia solo quella del mercato, come suggerisce Naomi Klein in Doppio.

È una nebbia di guerra digitalmente generata, una sovrapproduzione di contenuti incontrollabile e incontrollata che si frappone come un muro tra la narrazione dei fatti e la comprensione degli stessi. Un muro fatto soprattutto di immagini, di foto e video, perché nell’era del complottismo siamo ormai tutti troppo paranoici per concederci la libertà di credere a una balla che non abbia almeno un’immagine a corredarla e corroborarla. In poco più di due settimane di guerra, la lista di immagini false e fuorvianti, manipolate e manipolatorie passate sui social si è già fatta troppo lunga per essere riportata per intero. C’è stato il video del ragazzino steso a terra, apparentemente immerso in una pozza di sangue, circondato da uomini in kippah e soldati con addosso la divisa delle Forze di difesa israeliane che lo riprendevano con una cinepresa. Migliaia di persone lo hanno portato come prova del fatto che Israele avrebbe inscenato almeno una parte delle morti del 7 ottobre: si è scoperto poi che era il dietro le quinte di un cortometraggio palestinese intitolato Empty Place. Ci sono state le immagini del miliziano di Hamas che abbatte un elicottero israeliano con un lanciarazzi: alla fine è venuto fuori che il video era una cut scene del videogioco Arma 3. C’è stata la foto di un documento firmato da Biden con il quale il Presidente approvava l’invio in Israele di otto miliardi di dollari di armi: è venuto fuori che era un falso, una versione rozzamente modificata del documento che invece confermava l’invio di 400 milioni di dollari di aiuti militari all’Ucraina. C’è stata l’inchiesta co-firmata da Bbc e Bellingcat in cui si mostravano le prove del fatto che l’Ucraina avesse venduto ad Hamas le armi che le erano arrivate da Paesi Ue e Stati Uniti, bufala ripresa in un tweet dedicato anche dal troll maximo contemporaneo Dmitrij Medvedev. A nulla è servita la smentita del fondatore di Bellingcat in persona, Eliot Higgins.

“Misinformation is warfare”, ha scritto Joan Donovan sul Time. Il titolo di questo pezzo è una sottigliezza, perché in inglese la parola misinformation indica la diffusione di notizie false in buona fede, per così dire: non si sa, non si controlla, ci si crede, si condivide, si diffonde e così si diventa involontari ma volenterosi fiancheggiatori della disinformazione – che invece è un piano preciso che risponde a scopi specifici – tagliandone i costi e facilitandone il lavoro. A che servono, stante così le cose, troll farm e online troop? La misinformation sarà probabilmente l’altro nome della guerra di quinta generazione, quella basata sempre meno sull’azione cinetica e sempre più sui movimenti digitali.

E qui si arriva a discutere della più terrificante e devastante delle armi che saranno impiegate in questa nuova iterazione degli umani conflitti: le immagini generate dall’intelligenza artificiale. Per il momento, l’AI è ancora troppo imperfetta e immatura per essere efficacemente impiegata in questo fronte della guerra. Le scene belliche richiedono massima precisione proprio nei dettagli che oggi mettono maggiormente in difficoltà le AI: l’ondulare delle fiamme, le spire del fumo, i movimenti frenetici di folle di persone da accoppiare alla concitazione delle voci che urlano. Generare un’immagine o un video verosimile di un conflitto armato tra soldati o di una folla che fugge dopo un bombardamento è ancora oltre le capacità di apprendimento delle macchine. Ma di questa capacità non conosciamo i limiti. Non sappiamo nemmeno se esistano, questi limiti. E sono già tanti gli studiosi ed esperti del settore che suggeriscono di prepararsi a un mondo in cui non solo tutti pretenderanno la loro personale versione dei fatti, ma avranno pure accesso alle immagini che dimostrano che la loro è la versione dei fatti.

Un’anticipazione di quello che potrebbe essere e probabilmente sarà lo abbiamo avuto in questi giorni. Da quando è ricominciata la guerra tra Israele e Hamas, si è rivista anche una fotografia scattata nel 1993 da Ricki Rosen per la rivista canadese Maclean’s: ritrae due bambini, uno con la kippah e uno con la kefiah, che si abbracciano, un’immagine che voleva simboleggiare la speranza accesa dagli accordi di Oslo. La foto è riapparsa spesso nel mio feed social in questi giorni, accompagnata quasi sempre da commenti che riflettono lo spirito del tempo: lo sapete che è “falsa”, si premurano di sottolineare gli utenti.

C’è un’altra immagine che ho visto spessissimo in questi giorni: ritrae un neonato piangente, intrappolato sotto le macerie di un edificio distrutto. È stata postata, a turno, per raccontare l’assalto di Hamas ai kibbutz israeliani e i bombardamenti dell’esercito israeliano alle strutture civili di Gaza. L’immagine è, questa sì, un “falso”: è stata generata dall’AI, lo si capisce facilmente anche solo contando le sei dita sulla mano del neonato. Una velocissima reverse search rivela che era già circolata sui social dopo il terremoto in Turchia e Siria. L’immagine è stata comunque condivisa centinaia di migliaia di volte e visualizzata svariati milioni. E continua a essere visualizzata e condivisa ancora oggi.