Una crisi che colpirà soprattutto i giovani con poca esperienza lavorativa, già ampiamente rimpiazzati dall'AI in molte aziende.

Si è scoperto che l’AI viene usata anche per produrre poverty porn, cioè immagini piene di stereotipi sulla povertà utilizzate poi nella campagne di sensibilizzazione

Si trovano in vendita sulle piattaforme di foto stock, costano poco, non danno problemi di licenza né di consenso: è per questo che sono sempre più diffuse.

Le immagini generate con l’intelligenza artificiale che ritraggono la povertà sono sempre più spesso utilizzate da Ong e associazioni umanitarie per le proprie campagne di raccolte fondi, pubblicità e sensibilizzazione. Si trovano sulle piattaforme di foto stock e vengono usate per limitare i costi, non avere problemi di licenza né di consenso da parte dei soggetti ritratti nelle foto. Queste immagini si trovano ormai numerose su siti come Adobe Stock Photos e Freepik, per trovarle basta inserire chiavi di ricerca generiche come “povertà”, ma funzionano anche didascalie più specifiche come “Bambini asiatici nuotano in un fiume pieno di rifiuti” o “Medico caucasico villaggio africano”.

È un fatto risaputo che tante AI generative tendano a replicare, e talvolta a esagerare, i pregiudizi di cui internet è piena. La proliferazione di immagini distorte, stereotipate e fuorvianti nella comunicazione sanitaria e nelle campagne delle organizzazioni non governative potrebbe contribuire ad aggravare e diffondere ulteriormente questi pregiudizi, perché le immagini potrebbero poi essere usate per addestrare la prossima generazione di modelli di AI, dando inizio a un circolo vizioso difficilissimo da interrompere.

Il Guardian, a proposito di questo tema, ha interpellato Arsenii Alenichev, ricercatore presso l’Istituto di Medicina Tropicale di Anversa che studia la produzione di immagini sulla salute globale, che ha dichiarato: «Le immagini replicano la grammatica visiva della povertà: bambini con piatti vuoti, terra crepata, immagini stereotipate». Dall’altro lato, il Guardian ha raggiunto Joaquín Abela, Ceo di Freepik che ha affermato che la responsabilità dell’uso di immagini così estreme ricade sui consumatori e non su piattaforme come la sua perché «se i clienti di tutto il mondo vogliono immagini di un certo tipo, non c’è assolutamente nulla che nessuno possa fare». Adobe, come scrive il Guardian, non ha risposto.

La chiusura dell'app di generazione di video tramite AI è una notizia improvvisa ma non così imprevista: i problemi legali erano molti e grossi, tutti relativi al diritto d'autore.

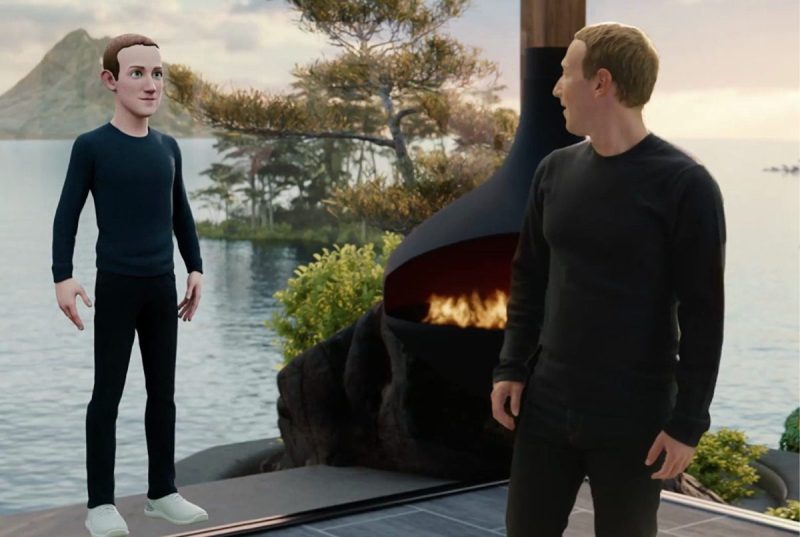

In molti hanno sottolineato una differenza sostanziale tra Zuckerberg e i dipendenti di Meta, però: lui non può essere licenziato e rimpiazzato dall'AI.