Centomila bilioni di parole scritti dalle macchine: l'ennesima splendida notizia per gli esseri umani che hanno ancora la velleità di guadagnarsi da vivere con la scrittura.

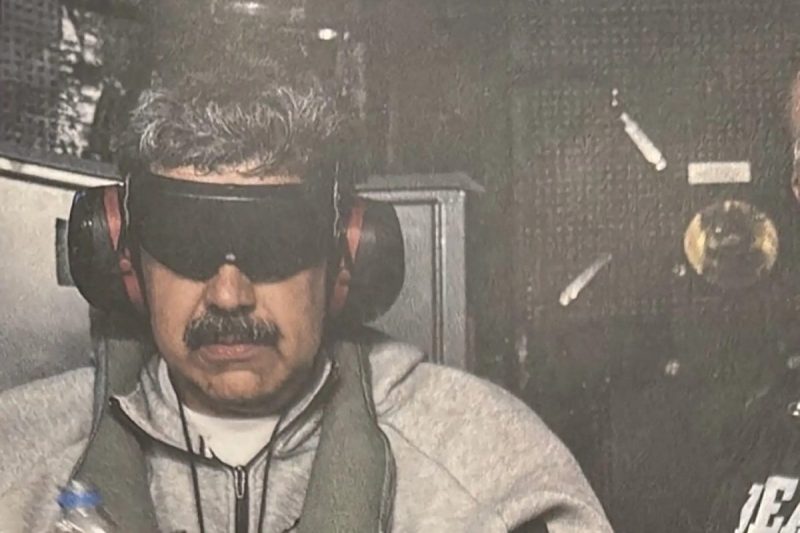

Per catturare Maduro l’esercito americano avrebbe usato anche l’intelligenza artificiale Claude

Lo ha svelato un'inchiesta del Wall Street Journal, che ha citato fonti anonime «vicine al Pentagono».

Il 3 gennaio 2026 il Presidente del Venezuela Nicolas Maduro è stato rapito e portato negli Stati Uniti da una squadra delle forze speciali statunitensi. Per l’operazione, anche se non è chiaro come e quando, sarebbe stato usato anche Claude, l’intelligenza artificiale sviluppata da Anthropic. A rivelarlo è un’inchiesta del Wall Street Journal, che lo ha definito un esempio di alto profilo di come il Dipartimento della Difesa statunitense stia utilizzando l’intelligenza artificiale nelle sue operazioni. Il raid statunitense in Venezuela ha comportato bombardamenti nella capitale Caracas e l’uccisione di 83 persone, secondo il ministero della Difesa venezuelano. Lo sottolineiamo perché i termini di utilizzo di Anthropic vietano l’uso di Claude per scopi violenti, per lo sviluppo di armi o per condurre attività di sorveglianza.

Se la notizia venisse confermata, Anthropic diventerebbe la prima AI impiegata in un’operazione dal Dipartimento della Guerra degli Stati Uniti. Non è chiaro come sia stato impiegata questa intelligenza artificiale, che ha capacità che vanno dall’elaborazione di pdf al pilotaggio di droni autonomi. L’ufficio stampa di Anthropic ha rifiutato di commentare la vicenda, ribadendo però che anche se l’AI fosse stata utilizzata in un’operazione militare, l’uso avrebbe dovuto essere rispettare le limitazioni di cui abbiamo scritto prima. Nemmeno il Dipartimento della Guerra degli Stati Uniti ha commentato l’inchiesta del Wall Street Journal. Nell’articolo, i giornalisti Amrith Ramkumar, Keach Hagey e Vera Bergengruen hanno citato fonti anonime, definite come «vicine al Pentagono», secondo le quali Claude sarebbe stato utilizzato grazie alla partnership di Anthropic con Palantir Technologies, un appaltatore del Dipartimento della Guerra degli Stati Uniti e delle agenzie federali di polizia. Anche Palantir ha rifiutato di commentare la vicenda, quindi non sappiamo se e come e quanto abbia fatto effettivamente da tramite tra Anthropic e il governo degli Stati Uniti.

In ogni caso, le forze armate Usa, come anche quelle di altri Paesi, utilizzano sempre più spesso l’IA come parte del loro arsenale. L’esercito israeliano, per esempio, ha utilizzato droni a guida autonoma – cioè pilotati da un’intelligenza artificiale – negli attacchi alla Striscia di Gaza e ha fatto ampio uso del cosiddetto algorithmic targeting, cioè un sistema algoritmico per decidere gli obiettivi militari da abbattere, fossero strutture o persone. A gennaio, il segretario alla Guerra (ex segretario della Difesa) Pete Hegseth ha affermato che il suo Dipartimento non avrebbe «utilizzato modelli di AI di cui non è consentito un impiego bellico». Nello stesso mese, il Pentagono ha annunciato che avrebbe collaborato con xAI, di proprietà di Elon Musk.

La chiusura dell'app di generazione di video tramite AI è una notizia improvvisa ma non così imprevista: i problemi legali erano molti e grossi, tutti relativi al diritto d'autore.

In molti hanno sottolineato una differenza sostanziale tra Zuckerberg e i dipendenti di Meta, però: lui non può essere licenziato e rimpiazzato dall'AI.