Era già successo nello scorso giugno, durante i precedenti attacchi di Usa e Israele. Anche in quel caso, i protagonisti era Trump, Netanyahu e Satana.

Un’immagine di una sola persona e venticinque minuti. Questo è quello che serve oggi per creare gratuitamente un deepfake pornografico di un minuto. Secondo i dati del CEE Digital Democracy Watch, quella persona è per il 99 per cento – quindi sicuramente – una donna. Non a caso, i modelli di AI creati per creare deepfake pornografici e sessualizzanti sono addestrati quasi esclusivamente su corpi femminili. La sessualizzazione non consensuale dei deepfake può danneggiare la reputazione e il benessere psicologico delle persone e viene utilizzata anche nell’ambito del cyberbullismo, con ricatti ed estorsioni sessuali, contribuendo al rafforzamento degli stereotipi di genere e all’oggettificazione della donna. Secondo più esperti in materia, le normative attuali – sia europee che americane – non sono adatte ad affrontare questo fenomeno, in quanto spesso ambigue, imprecise e non tutelanti.

Come si genera una violazione online

A gennaio 2026, Grok – il chatbot di intelligenza artificiale progettato dal proprietario di X, Elon Musk – ha generato delle immagini realistiche di persone reali compresi minori con dei semplici comandi come “mettile un bikini” o “toglile i vestiti”. In risposta, X ha limitato la generazione di queste immagini solo per gli abbonati paganti. L’AI di Grok è stato “un ottimo esempio di abuso dell’infrastruttura per creare immagini specifiche ed esplicite, soprattutto di donne perché per lo più sono loro a essere prese di mira da deepfake di questo tipo. «Si trattava di contenuti intimi», spiega Mateusz Łabuz, ricercatore presso il CEE Digital Democracy Watch e per l’Istituto di ricerca sulla pace e la politica di sicurezza dell’Università di Amburgo. «Abbiamo visto Elon Musk ridere delle vittime e mettere una sua foto in bikini per dire “questo non è poi così un problema” mentre ciò che sappiamo quando ci rivolgiamo alle esperienze delle vittime di violenza online è che subiscono le stesse identiche conseguenze delle vittime di abusi sessuali basati sulle immagini con contenuti reali», racconta la ricercatrice digitale e autrice del libro Internet non è un posto per femmine, Silvia Semenzin.

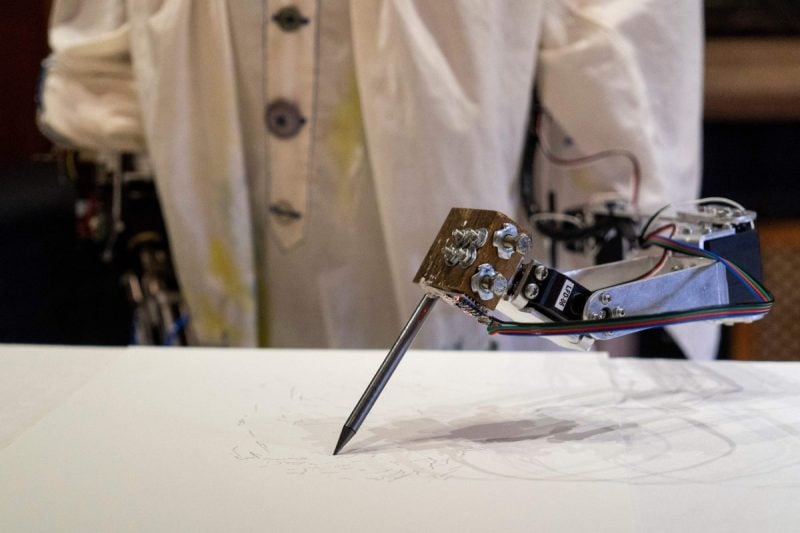

La forza degli strumenti di sessualizzazione non consensuale (NSTs) risiede nella semplicità di poter creare deepfake perché, come spiega Łabuz, non servono competenze specifiche e i social media, che utilizziamo quotidianamente, sono terreno fertile per la proliferazione di immagini non consensuali – sia di donne che minori. «Alcune app per spogliarsi stimano le condizioni del corpo, i fattori in relazione alla forma del corpo, e immaginano come apparirebbe quella persona quando è nuda. Analizzando centinaia, migliaia di diverse immagini esplicite, hanno già un’idea di come appare il corpo umano quando è nudo, e possono adattarsi alle condizioni e ai dettagli della persona specifica. Quindi, se hai una semplice foto del tuo viso mentre sei chiaramente visibile, può essere usata come base per immagini esplicite. Chiunque può essere preso di mira, e questo è il grosso problema in termini di materiale pedopornografico. Quindi non si tratta solo di contenuti per adulti, ma anche di contenuti per bambini e pedofilia, perché se pubblichi le foto di tuo figlio, possono essere scaricate da persone che possono poi usarle per creare materiale pedopornografico». In questo senso, può essere difficile sporgere una eventuale denuncia poiché l’intelligenza artificiale generativa «viene utilizzata anche da persone sconosciute alle vittime» e «le piattaforme digitali non collaborano: siamo in un momento in cui i giganti della tecnologia stanno combattendo tutte le battaglie femministe, e lo stiamo vedendo. Stanno insieme a Donald Trump, cercando di eliminare tutte le normative in Europa», analizza Sementin.

La maggior parte delle “nudify app” – come DeepNude, pubblicata nel 2019, che consente agli utenti di svestire digitalmente immagini di donne vestite e che non funziona con immagini di uomini – sono scomparse dagli store digitali in Europa. «Ma nelle community di Reddit e sul darknet, si trovano già istruzioni chiare su come usare app specifiche, come scaricarle, come usarle, come applicarle, come migliorarle, in modo che funzionino e soprattutto, ci sono persone che vogliono essere pagate per creare deepfake specifici», racconta il ricercatore del CEE Digital Democracy Watch.

Perché lo spazio digitale non è un posto per femmine

Il libro Internet non è un posto per femmine è stata l’occasione che la ricercatrice digitale Semenzin ha colto per raccontare “finalmente” anche la propria storia personale. «Io stessa sono una survivor di abusi sessuali basati sulla mia immagine», sottolineando come la sua non sia diversa dalle altre storie che migliaia di donne vivono ogni giorno. «L’unica differenza è che io, per la mia tempra e anche per i miei studi, mi trovavo in un posto in cui potevo anche recuperare dati sull’argomento e passare dalla mia esperienza personale a una più collettiva, promuovendo una campagna in Italia per chiedere una legge che criminalizzi la diffusione non consensuale di immagini intime nel 2018».

Agli albori, racconta Semenzin, internet era il posto delle donne – in quanto soggetto attivo – poiché sono state pioniere dello spazio digitale che hanno creato. «I primi codici informatici, gli algoritmi sono stati creati da donne». Poi tutto, è stato mascolinizzato e trattato come un dominio maschile. «Sembra che negli ultimi decenni il movimento femminista abbia in un certo senso lasciato da parte la discussione su tutto ciò che riguarda il digitale, perché ci siamo mosse verso una posizione critica pur comprensibile considerando il livello generale di violenza e oppressione», spiega. Oggi, gli algoritmi delle grandi piattaforme digitali, in particolare dei social media, ma anche delle piattaforme di streaming e delle app di messaggistica, sono prima di tutto algoritmi commerciali perché l’obiettivo finale è vendere un prodotto. «Il capitalismo è anche profondamente legato ai valori patriarcali perché è molto radicato nella divisione del lavoro, e negli stereotipi di genere, Non è un caso che stiamo assistendo, per esempio, a una crescita del fenomeno delle “mogli tradizionali”, le tradwives. Nella versione “soft” dell’espressione dell’algoritmo, ci sono le ragazze che parlano di uomini mentre si truccano, continuando ad abbracciare un ruolo di genere stereotipato ed efficiente, con un prodotto tra le mani da vendere. È importante ricordare però per Semenzin che quello spazio va rivendicato. «Dobbiamo lottare anche per ottenere alternative, almeno su internet, perché abbiamo bisogno di internet per organizzare, coordinare e trovare soluzioni politiche anche se in questo momento è davvero complicato».

Oggi, in Europa, ci sono diverse iniziative dal basso che forniscono supporto alle sopravvissute della violenza da AI generativa. Ad esempio, la Comunità Catalana ha lanciato una piattaforma interamente finanziata con denaro pubblico per aiutare le sopravvissute alla violenza digitale: partendo da zero, offrendo assistenza legale, psicologica e tecnica gratuitamente e fino alla fine del processo. Tuttavia, non sono abbastanza e peccano di sostegno economico per reggersi in piedi.

Effettivamente tutte e nessuna esclusa, anche Giorgia Meloni

Alcune app di AI gratuite usate per “denudare” contengono persino spyware o adware integrati nei siti web. Di conseguenza, le vittime non solo subiscono traumi a causa della distribuzione di materiale che raffigura la loro immagine in situazioni intime ma devono anche dimostrare che tale materiale è falso, e hanno difficoltà a far rispettare la legge a causa dell’ambiguità di quelle esistenti o persino della mancanza di qualifiche legali. Queste app, «violano la privacy intima delle persone colpite, con conseguenze devastanti: causano sofferenze psicologiche come depressione e ansia. In passato, la violenza sessuale digitale ha già portato al suicidio. Le vittime riferiscono di sentirsi personalmente attaccate, ferite e umiliate, alcune subiscono le conseguenze come se fossero state aggredite sessualmente. I deepfake sessualizzanti non consensuali possono anche comportare svantaggi nell’ambiente privato e lavorativo», si legge ancora nel rapporto di CEE Digital Democracy Watch.

Anche la deputata greca del gruppo di maggioranza del Parlamento europeo, Eleonora Meleti, ha condiviso la sua storia personale di vittima di nudify app. Dopo aver consultato il proprio avvocato, si è trovata di fronte alla frustrazione: «Non c’è niente che possiamo fare», le è stato detto. La frustrazione, a volte, spesso porta anche alla tragedia. «Le ragazze in genere – tra i quaranta casi che abbiamo avuto – si suicidano tra i due e i cinque anni dopo l’accaduto», spiega Andrea Powell, ideatrice e co-fondatrice della statunitense June Coalition, un’organizzazione globale guidata da sopravvissute di abusi sessuali prodotti da immagini non consensuali o generative.

Powell racconta l’esperienza della June Coalition, che prende il nome dall’hotel in cui si sono incontrare le persone per dare vita alla comunità di sostegno per le vittime. Nel 2022, «eravamo una rete di circa 60 persone provenienti da 19 Paesi, che erano loro stesse sopravvissute a diverse forme di abuso sessuale basato sull’immagine. Il nostro obiettivo, onestamente, era quello di comprendere più a fondo quali fossero i punti critici, quali fossero le sfide nel pubblicare contenuti, quali fossero le conseguenze, come venivano trattati dalle forze dell’ordine. Abbiamo raccolto centinaia di pagine di contenuti e li abbiamo suddivisi in venti raccomandazioni per la Casa Bianca, per le aziende tecnologiche e per i decisori politici, concentrandoci su tre temi principali, ovvero la rimozione permanente dei contenuti, la mancanza di accessibilità a una reale tutela legale e un migliore supporto per la salute mentale».